최신연구

[조민수 교수] DINOv2 Meets Text: A Unified Framework for Image- and Pixel-Level Vision-Language Alignment

[연구의 필요성]

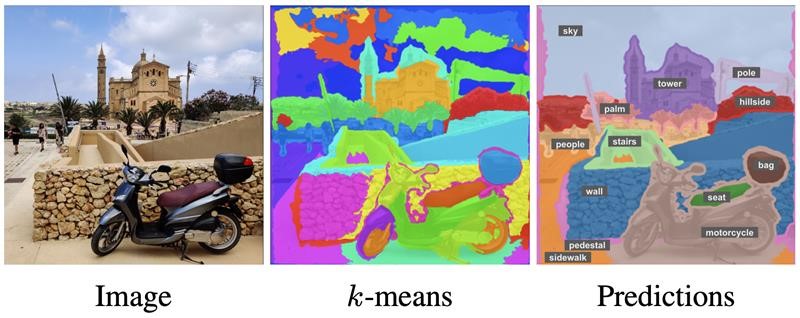

기존의 CLIP (Radford et al., 2021) 과 같은 image-text encoder 들은 영상을 언어기반으로 전체적으로 이해하는 능력은 뛰어나지만 영상의 부분적 이해, 즉 픽셀 단위를 언어 기반으로 이해하는 능력은 몹시 부족하였음.

[포스텍이 가진 고유의 기술]

본 연구에서는 기존의 자기 지도 학습 기반 비전 모델인 DINOv2 를 기반으로 훌륭한 시각적 이해도를 가진 모델로부터 언어-영상의 픽셀 기반 이해 능력을 갖는 고성능 언어 기반 영상 인식 모델을 개발함

[연구의 의미]

픽셀 기반 언어 인식 능력은 픽셀 기반 추가 기술들이 필요한 고도의 작업이었으나, 본 연구에서 개발한 모델은 image-text encoder 에서 이미 훌륭한 픽셀-언어 이해도를 보유하고 있기 때문에 각종 추가 테크닉 없이도 언어 기반 영상 분할 평가 방식에서 고성능을 달성함.

[연구결과의 진행 상태 및 향후 계획]

본 연구는 컴퓨터 비전 최고 수준 학회인 CVPR 2025 에 2025년 6월에 발표와 출판을 앞두고 있음.

[성과와 관련된 실적]

Cijo Jose, Théo Moutakanni, Dahyun Kang, Federico Baldassarre, Timothée Darcet, Hu Xu, Daniel Li, Marc Szafraniec, Michaël Ramamonjisoa, Maxime Oquab, Oriane Siméoni, Huy V. Vo, Patrick Labatut, Piotr Bojanowski. DINOv2 Meets Text: A Unified Framework for Image- and Pixel-Level Vision-Language Alignment. CVPR 2025.

[성과와 관련된 이미지]