최신연구

[김동우 교수] Robust Evaluation of Diffusion-Based Adversarial Purification

[연구의 필요성]

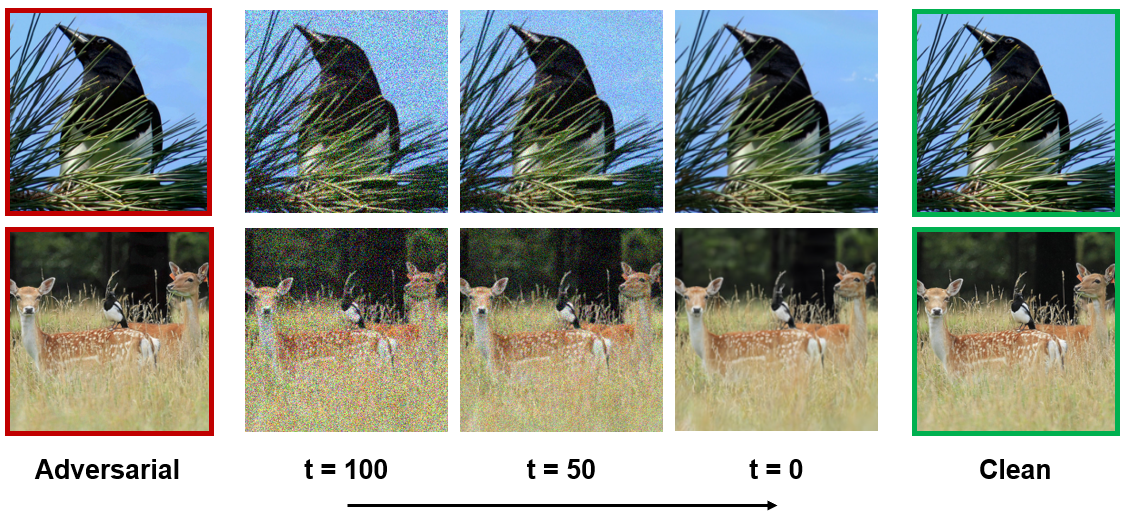

적대적 공격 (Adversarial attack)은 입력값에 약간의 노이즈를 섞어 딥러닝 모델이 제 역할을 수행하지 못하도록 하는 공격 방식의 일종이다. 이러한 공격을 방어하기 위해 제안된 디퓨전 모델 (Diffusion model) 기반의 적대적 정화 기법 (Adversarial Purification) 은 디퓨전 모델을 활용하여 이미지의 노이즈를 정화하여 이 공격을 방어하는 기법으로 현재 좋은 성능을 갖고 있다고 알려져 있다. 하지만, 이와 같은 종류의 방어 기법들은 쉽게 우회하여 무력화 가능하다고 알려져 왔지만, 아직 디퓨전 모델 기반 적대적 정화 기법에 대해서는 연구가 부족한 상황이다.

[포스텍이 가진 고유의 기술]

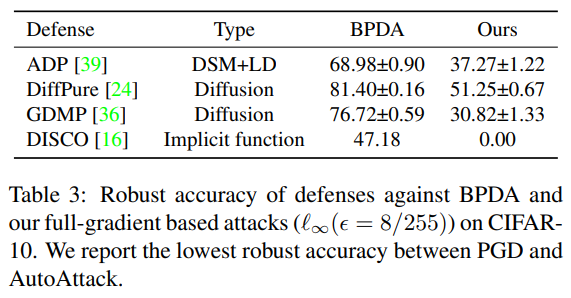

디퓨전 모델 기반 적대적 정화 기법의 현재 평가 방식의 문제점에 대해 지적하고, 더 정확히 방어 기법의 성능을 평가할 수 있는 방법의 가이드라인을 제공했다. 또한, 디퓨전 모델은 방어 성능에 영향을 줄 수 있는 매개 변수를 상당히 보유하고 있기 때문에, 각 하이퍼파라미터와 더불어 기존의 테크닉에 대해 심층적으로 분석했다. 또한 디퓨전 모델 기반 적대적 정화 기법의 방어 성능을 향상시키기 위해 새로운 방식의 방어 전략을 제안했고, 이를 통해 방어 성능을 향상시켰다.

[연구의 의미]

현재 좋은 성능을 보여주고 있는 디퓨전 모델 기반 적대적 정화 기법의 성능을 정확히 판단할 수 있는 방법에 대한 가이드라인을 제공하였다는 점에서 큰 의미가 있으며, 디퓨전 모델의 매개 변수를 분석하고 새로운 전략의 방어 기법을 제안함으로써, 앞으로 적대적 정화 기법의 성능 개선을 위한 방향을 제시하였다.

[연구결과의 진행 상태 및 향후 계획]

본 연구는 컴퓨터 비전 분야 최우수 학회인 ICCV 2023에 Oral presentation(선정률 4%미만)으로 발표될 예정이다. Diffusion model을 활용하여 다른 문제를 해결하고자 계획하고 있다.

[성과와 관련된 실적]

Minjong Lee, and Dongwoo Kim, “Robust Evaluation of Diffusion-Based Adversarial Purification”, ICCV 2023 (Oral presentation)

[성과와 관련된 이미지]